#

Large-Language-Modelle (LLMs)

Im aiWorkplace stehen verschiedene Large-Language-Modelle (LLMs) zur Verfügung, die für Chat, Text-, Code- und Grafikgenerierung uvm. genutzt werden.

#

Voraussetzungen und Einrichtung

Damit LLMs genutzt werden können, müssen sie im Administrationsbereich von den Organisations-Inhaber bereitgestellt und freigeschaltet werden. Navigieren Sie dazu über Ihr Profil oben rechts zu Einstellungen > Modelle und aktivieren Sie die gewünschten Modelle.

Es empfiehlt sich, nicht alle verfügbaren Modelle freizuschalten, sondern eine überschaubare Auswahl bereitzustellen. So behalten Nutzer*innen den Überblick und es ist einfacher, Kosten, Qualität und Einsatzzwecke zu steuern.

#

Modellauswahl

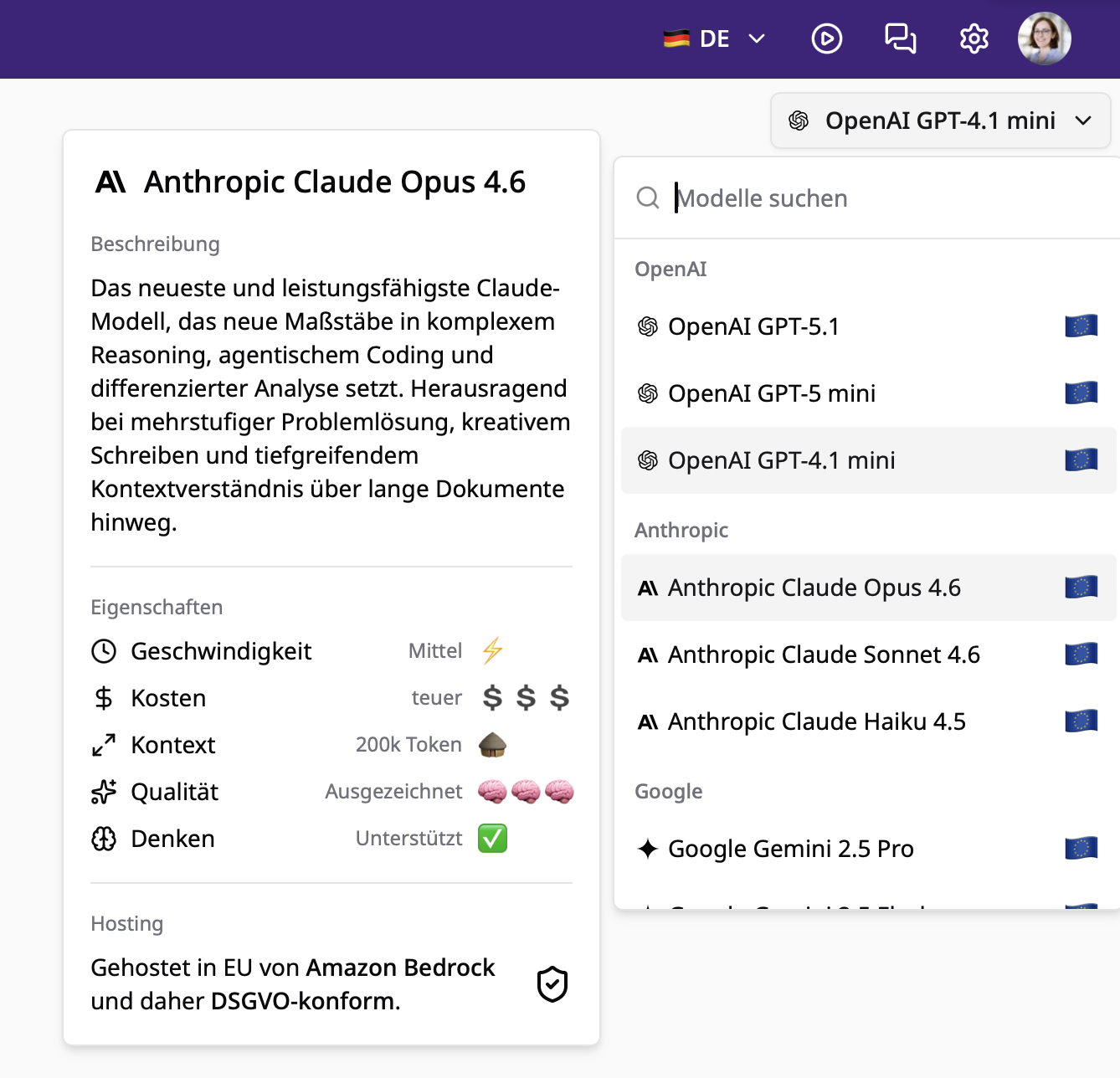

Im aiWorkplace können im Chat Modelle unterschiedlicher Anbieter genutzt werden, zum Beispiel:

- kommerzielle Modelle von OpenAI, Anthropic, Google, Mistral

- Open-Source-Modelle wie DeepSeek, Qwen, Kimi, GLM oder MiniMax

Die Modelle werden alle DSGVO-konform in Europa gehostet und eingegebene Daten werden nicht für Modelltraining verwendet.

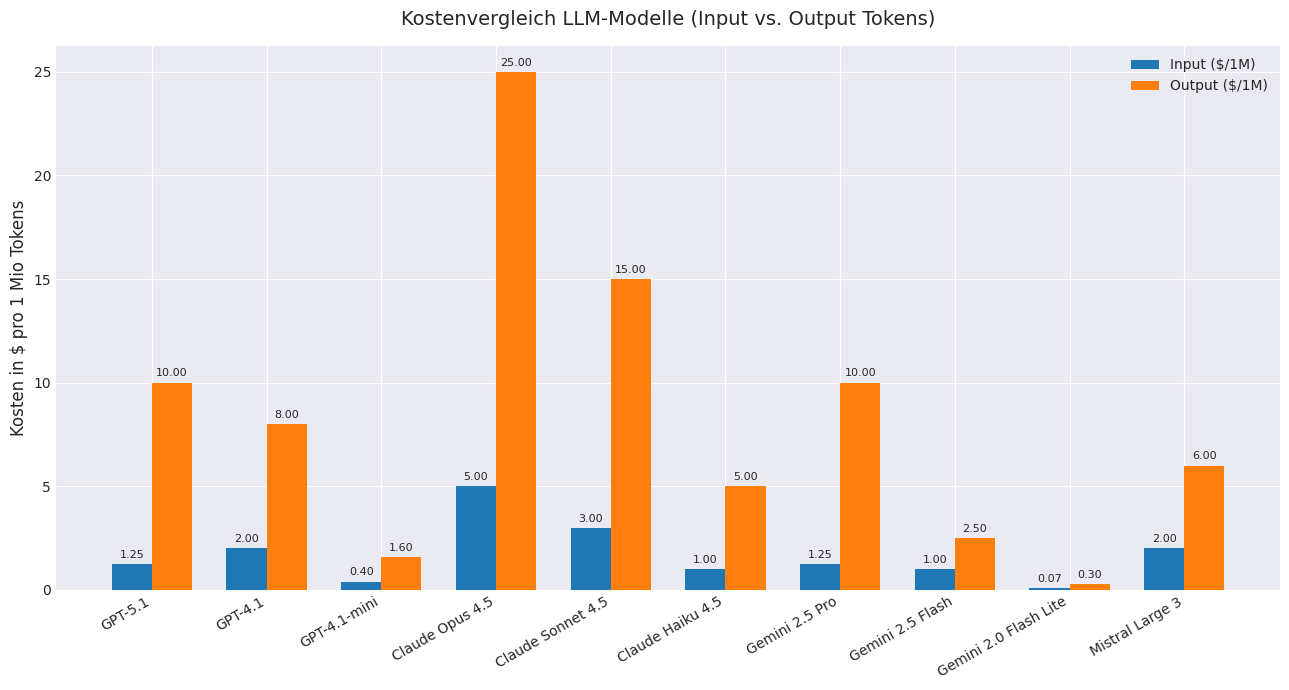

Modelle unterscheiden sich vor allem in Kosten, Leistung und Geschwindigkeit: Leichtgewichtige, kostengünstige Modelle eignen sich für einfache Routineaufgaben wie kurze Zusammenfassungen oder Umformulierungen, während leistungsstärkere (oft teurere) Modelle bessere Ergebnisse bei komplexen, geschäftskritischen Aufgaben wie tiefgehenden Analysen, Coding oder anspruchsvoller Planung liefern.

#

Empfohlene Modellauswahl (kommerzielle Anbieter)

Die Modellauswahl bietet eine Mischung aus unterschiedlichen Kosten und Qualitäten von unterschiedlichen Anbietern. Wenn Sie bestimmte Anbieter präferieren, können Sie die Auswahl weiter reduzieren.

#

Modellauswahl: Open Source-Alternativen

Alternativ zu kommerziellen Modellen stehen auch Open Source Modelle zur Verfügung. Diese sind zwar weniger bekannt, aber kostengünstig und erreichen bei den meisten Aufgaben 90-98% der Performance von kommerziellen Modellen. Sie haben außerdem den Vorteil, dass sie auch im eigenen Rechenzentrum (on premise) betrieben werden können.

Empfehlung: Nutzende halten sich bei der Adoption weniger bekannter Modelle häufig eher zurück. Starten Sie mit einem etablierten kommerziellen Modell als Standard und testen Sie parallel ein äquivalentes Open Source Modell für unkritische Aufgaben.

(R) = Erweitertes Denken aktiv

#

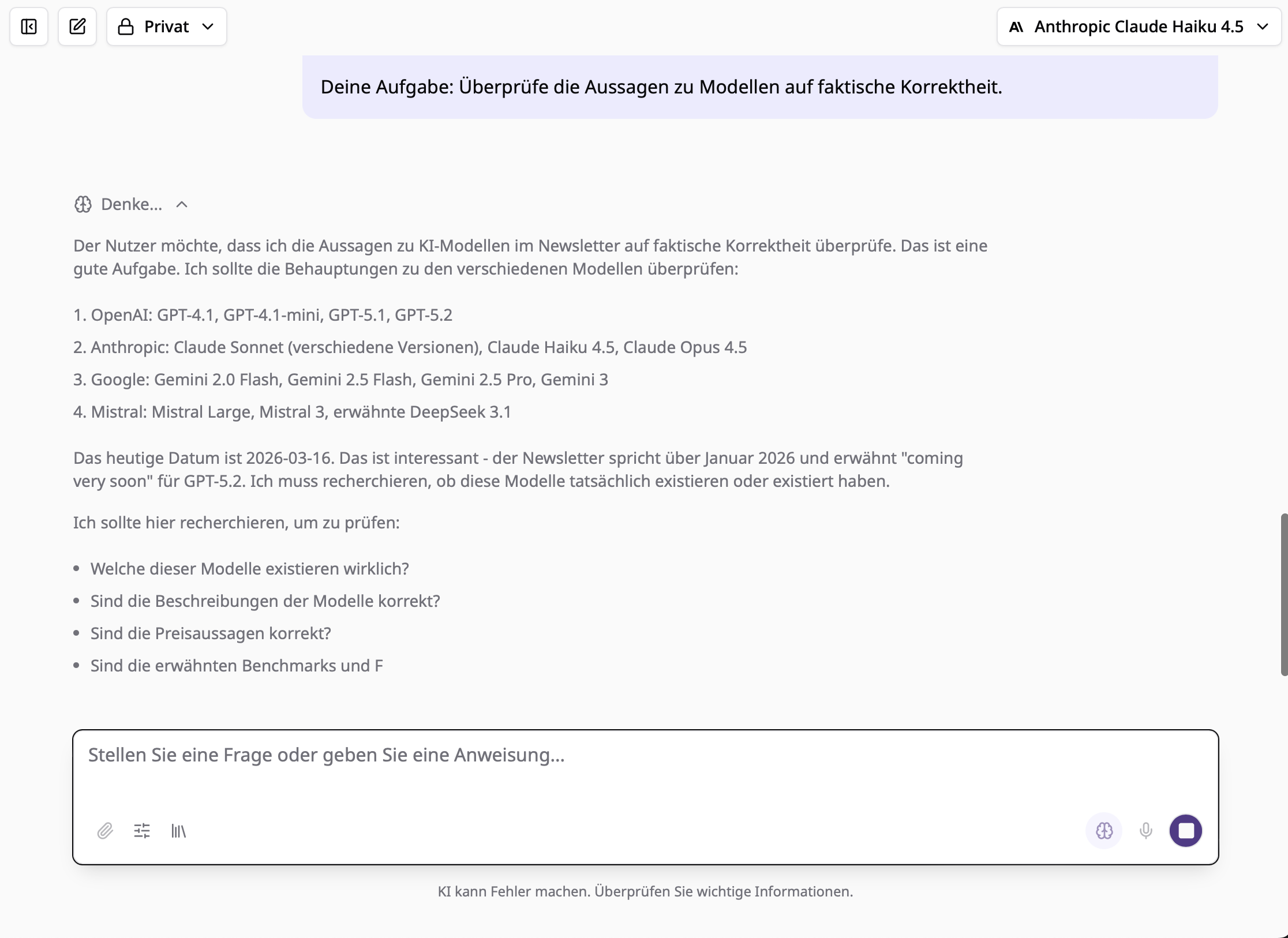

Erweitertes Denken

Für einige Modelle steht im aiWorkplace die Option Erweitertes Denken (Reasoning-Modus) zur Verfügung, zum Beispiel bei neueren Anthropic-Modellen oder Google Gemini 2.5 Pro. Dieser kann über das Gehirn-Symbol im Chat aktiviert und deaktiviert werden.

Wenn Erweitertes Denken aktiviert ist, führt das Modell zusätzliche Reasoning-Schritte aus und kann so strukturiertere, besser begründete Antworten liefern, insbesondere bei komplexen Fragestellungen mit mehreren Teilschritten. Die Antworten können dadurch etwas länger dauern und verursachen in der Regel höhere Kosten pro Anfrage. Geeignet ist der Reasoning-Modus vor allem für mehrstufige Analysen und Planungen, Aufgaben mit komplexen Abhängigkeiten sowie Fälle, in denen nachvollziehbare Begründungen besonders wichtig sind. Für kurze, einfache Anfragen kann Erweitertes Denken meist deaktiviert bleiben, um Laufzeit und Kosten zu reduzieren.

Der entscheidende Kostentreiber bei erweitertem Denken sind die Output-Tokens. Insbesondere bei Claude Opus und Claude Sonnet ist der KI-Punkte-Verbrauch in diesem Modus daher sehr hoch und sollte sparsam eingesetzt werden.